Robots.txt en WordPress

No todas las subpáginas o todos los directorios de tu web son tan importantes como para que los motores de búsqueda convencionales los rastreen sin falta. Con la ayuda del archivo robots.txt gestiona la indexación de tu sitio y determina qué subpáginas de WordPress debe tener en cuenta el rastreador y cuáles no. De esta manera, posicionarás tu web significativamente mejor en las búsquedas online. Aquí te explicamos qué hace el archivo robots.txt en WordPress y cómo puedes optimizarlo tú mismo.

- Gratis SSL Wildcard para transferencias de datos más seguras

- Gratis registro privado para más privacidad

¿Qué es el archivo robots.txt de WordPress?

Los denominados rastreadores buscan páginas web en Internet las 24 horas del día. Estos bots los envían los respectivos motores de búsqueda y detectan el mayor número posible de páginas y subpáginas (indexación) para ponerlas a disposición de la búsqueda. Para que los rastreadores lean tu web correctamente, es necesario guiarlos. De este modo, evitarás indexar contenido irrelevante para los motores de búsqueda y te asegurarás de que el rastreador solo lea el contenido que debe leer.

Puedes utilizar robots.txt para controlar este aspecto. Con WordPress y otros CMS, se utiliza este archivo para determinar qué áreas de tu web deben detectar los rastreadores y cuáles no. A través de robots.txt puedes excluir o autorizar bots y también hacer distinciones precisas sobre qué motores de búsqueda encuentran qué entradas para luego reproducirlas en la búsqueda. Dado que cada dominio solo dispone de un presupuesto de rastreo limitado, es aún más importante impulsar las páginas principales y eliminar las subpáginas insignificantes del volumen de búsqueda.

Hazte con el dominio de tus sueños en solo unos pasos. Registra tu dominio perfecto cómodamente en IONOS y benefíciate de un excelente servicio, numerosas características de seguridad y un buzón de correo electrónico con una capacidad de 2 GB.

¿Para qué hace falta el archivo robots.txt en WordPress?

Usar robots.txt para especificar en WordPress exactamente qué contenido se indexará y cuál no ofrece numerosas ventajas. Mientras que, por ejemplo, tu página de inicio debe tener una buena clasificación en todas las búsquedas adecuadas, la cosa cambia con el aviso legal de la web.

Los comentarios o archivos tampoco aportan ningún valor añadido en la búsqueda y pueden, por el contrario, incluso representar una desventaja, por ejemplo, si los motores de búsqueda los reconocen como contenido duplicado y lo evalúan negativamente. Con un archivo robots.txt en WordPress, puedes evitar estos casos de la mejor manera posible y guiar a los diferentes rastreadores para que se centren en las áreas de tu sitio web que realmente quieres que encuentren.

El archivo automático robots.txt de WordPress

Al principio, el propio WordPress crea un archivo robots.txt y, por tanto, realiza un trabajo preliminar básico. Sin embargo, no es muy completo y, por lo tanto, debe considerarse principalmente como un punto de partida. Tiene este aspecto:

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/El “user-agent” de la primera línea hace referencia a los rastreadores. “*” expresa que todos los motores de búsqueda están autorizados a enviar sus bots a tu página. Por norma general, esta situación es la más recomendable para comenzar, ya que será más fácil encontrar tu sitio web de esta manera.

El comando “Disallow” bloquea los siguientes directorios para los rastreadores, en este caso son la administración y el directorio de todos los archivos de WordPress. robots.txt los bloquea para los motores de búsqueda, ya que a los visitantes no se les ha perdido nada en las respectivas páginas. Para asegurarte de que solo tú puedas acceder a ellas, protege estas áreas con una buena contraseña.

Como administrador puedes proteger tu login de WordPress adicionalmente a través del archivo .htaccess.

¿Qué debe contener un archivo robots.txt de WordPress?

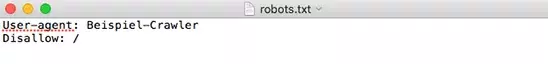

Obviamente, los motores de búsqueda, como Google, deben seguir encontrando tu página sin dificultad. Sin embargo, los servicios más dañinos o dudosos, como DuggMirror, es mejor que no la encuentren. Para excluir estos servicios puedes usar robots.txt de WordPress. Además, debes excluir de la indexación los temas, tu aviso legal y otras páginas que tengan poca o ninguna relevancia. Los plugins tampoco se deben indexar, no solo porque no son relevantes para el público, sino también por razones de seguridad. Si un plugin tiene un problema de seguridad, los atacantes pueden encontrar y dañar tu sitio web de esta manera.

En la mayoría de los casos, los dos comandos mencionados anteriormente bastarán para hacer un buen uso de robots.txt en WordPress: “User-agent” define a qué bots hay que llamar. De este modo, puedes configurar excepciones para determinados motores de búsqueda o establecer reglas básicas. “Disallow” prohíbe a los rastreadores el acceso a una página o subpágina correspondiente. El tercer comando, “Allow”, no es relevante en la mayoría de los casos, ya que el acceso está permitido por defecto. Solo necesitas este comando si quieres bloquear una página web completa, pero autorizar alguna de sus subpáginas.

El camino más rápido hacia tu propio sitio web: Hosting de WordPress de IONOS destaca por sus múltiples ventajas. Aparte de tres dominios gratuitos de forma permanente, incluye SSD, HTTP/2 y gzip. Elige el modelo de tarifa que más te convenga.

Cambiar robots.txt en WordPress de forma manual

Para realizar ajustes individuales, es recomendable que amplíes tú mismo el archivo robots.txt de WordPress. Para ello, basta con seguir unos sencillos pasos.

Paso 1. Primero, crea un archivo vacío llamado “robots.txt” en cualquier editor de texto.

Paso 2. A continuación, carga este archivo en el directorio raíz de tu dominio.

Paso 3. Ahora puedes editar el archivo a través de SFTP o subir un nuevo archivo de texto.

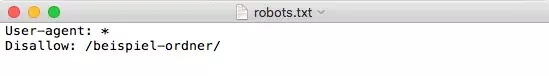

Con los comandos explicados anteriormente puedes definir ahora qué reglas y excepciones se aplicarán en tu sitio web. Para bloquear el acceso a una carpeta específica:

Plugins para la creación de un archivo robots.txt en WordPress

También puedes crear y editar el archivo robots.txt en WordPress con un plugin de SEO de WordPress. Esto se hace de forma cómoda y segura desde el panel de control y, por tanto, puede que sea todavía más sencillo. Yoast SEO es uno de los plugins más usados para este propósito.

Paso 1. Primero debes instalar y activar el plugin.

Paso 2. A continuación, permite que el plugin pueda realizar cambios avanzados. Para ello, ve a “SEO” > “Dashboard” >, “Features” y haz clic en el botón “Enabled” del punto “Advanced settings pages”.

Paso 3. Después de esta activación, realiza los cambios en el panel de mando en “SEO” > “Tools” > “File editor”. Allí puedes crear y editar directamente un nuevo archivo robots.txt en WordPress. Las modificaciones se aplicarán directamente.

¿Cómo se pueden probar los cambios?

Ahora has configurado tu sitio web, has establecido reglas y, al menos en teoría, has bloqueado a los rastreadores y has hecho invisibles las subpáginas. Pero ¿cómo saber si todos los cambios se han realizado realmente? Google Search Console es la respuesta. Allí encontrarás el “probador de robots.txt” en la sección “Rastreo” del lado izquierdo. Allí introduces tus páginas y subpáginas y luego verás si se pueden encontrar o están bloqueadas. Un “Permitido” verde en la parte inferior derecha significa que los rastreadores encontrarán y tendrán la página en cuenta, un “Bloqueado” rojo significa que la página no se indexará.

En resumen: robots.txt optimiza y protege tu web

El archivo robots.txt es un método simple y efectivo para que WordPress determine qué áreas de tu sitio se deben poder encontrar y por parte de quién. Si de por sí ya usas un plugin de SEO como Yoast, lo más fácil es hacer los cambios con dicho plugin. De lo contrario, el archivo también puede crearse y editarse manualmente sin ningún problema.

En la Digital Guide de IONOS encontrarás valiosos consejos sobre el tema WordPress. Te ayudamos a solucionar problemas en WordPress, te explicamos cómo optimizar WordPress y te mostramos qué es Gutenberg de WordPress. Seguro que encuentras las respuestas que buscas.