RAG: O que é Retrieval Augmented Generation

RAG, Retrieval-Augmented Generation ou, em português, Geração Aumentada de Recuperação, é uma tecnologia que aprimora modelos de linguagem generativa ao resgatar informações relevantes de fontes de dados internas e externas. Ao fazer isso, ela consegue fornecer respostas mais precisas e contextualmente relevantes. Conheça as vantagens da RAG e descubra se ela pode ser interessante para a sua empresa.

- Online em segundos

- Aumente seu crescimento com marketing de IA

- Economize tempo e recursos

O que é Retrieval-Augmented Generation?

Retrieval-Augmented Generation é uma tecnologia capaz de otimizar resultados apresentados por modelos de linguagem de grande escala (LLM). Em linhas gerais, a RAG funciona da seguinte maneira: em resposta a uma solicitação de um usuário, o sistema que a utiliza inicialmente realiza pesquisas em grandes quantidades de dados, para encontrar informações relevantes. Entre essas fontes estão bancos de dados internos e externos, a internet e outros. Após reunir os dados apropriados, o sistema utiliza algoritmos avançados para gerar uma resposta compreensível e precisa, a partir desses dados encontrados.

Modelos de linguagem de grande escala são essenciais para o desenvolvimento da inteligência artificial (IA), especialmente da voltada a chatbots, robôs de bate-papo inteligentes que utilizam aplicações de processamento de linguagem natural (natural language processing: NLP). O principal objetivo desse modelo de linguagem é criar bots capazes de responder, de maneira precisa, perguntas de usuários dos mais diferentes contextos. Para tanto, eles devem acessar fontes de informação confiáveis.

Apesar do alto desempenho que registram, LLMs também enfrentam alguns desafios. Por exemplo, eles podem fornecer respostas incorretas quando não encontram informações adequadas o suficiente para a resposta. Além disso, como aprendem com o grande volume de texto da internet e de outras fontes, eles frequentemente assimilam preconceitos e estereótipos contidos nesses dados. Ainda, os dados que os treinam são coletados em momentos específicos, o que significa que o conhecimento desses modelos se limita a um período de tempo, não sendo atualizado automaticamente. O fato pode levar à geração de respostas aos usuários com informações desatualizadas.

Ao combinar RAG e LLMs, tais limitações podem ser superadas. A Retrieval-Augmented Generation é capaz de complementar a capacidade de LLMs, encontrando e processando informações atuais e relevantes, e gerando respostas mais precisas e confiáveis.

Como funciona a Retrieval-Augmented Generation?

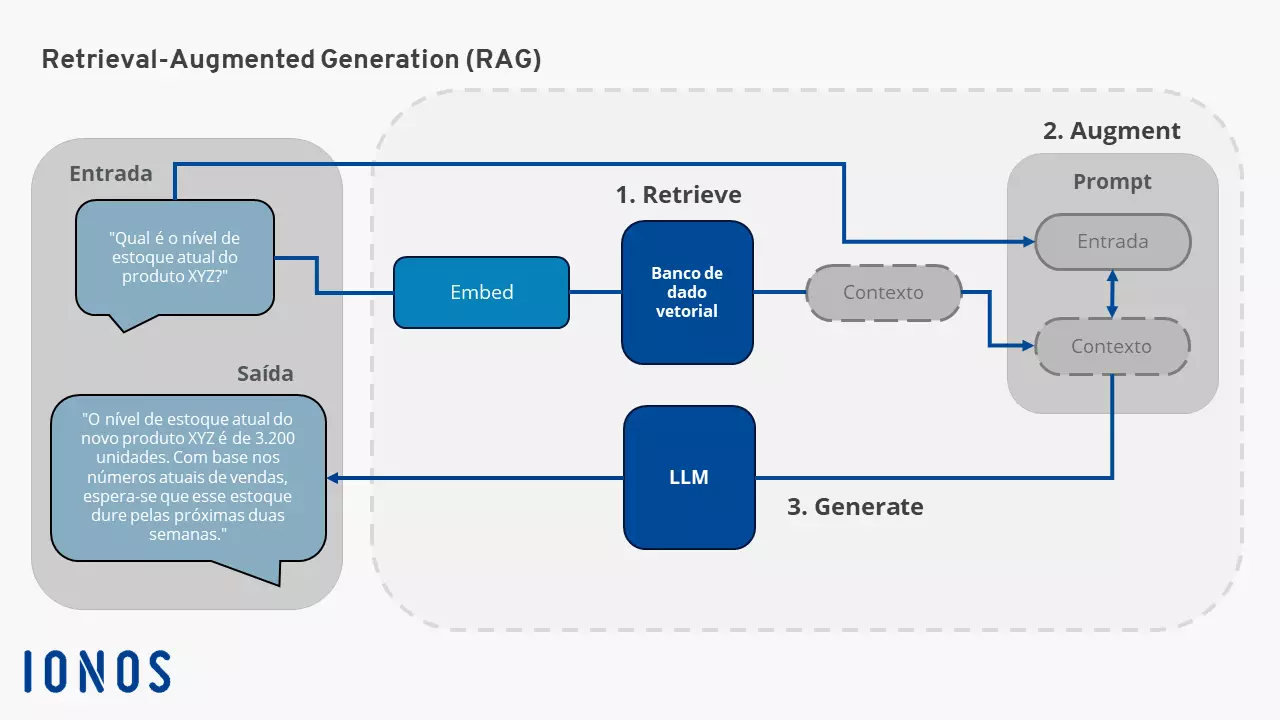

A RAG funciona em várias etapas para conseguir fornecer respostas precisas e úteis. A seguir, explicaremos o passo a passo de seus processos:

Preparar base de conhecimento

O primeiro passo realizado pela RAG consiste na preparação de uma coleção abrangente de textos, conjuntos de dados, documentos e outras fontes de informação. Essa coleção servirá de base de conhecimento para a busca de informações relevantes, juntamente com o conjunto de dados de treinamento do próprio LLM. Entre as fontes de dados possíveis podem estar bancos de dados, repositórios de documentos e outras fontes externas.

A eficácia de um sistema com Retrieval-Augmented Generation dependerá fortemente da qualidade e da disponibilidade dos dados que ele acessa. Dados incompletos ou incorretos, portanto, podem comprometer os resultados apresentados.

Incorporar bancos de dados vetoriais (embed)

Aspecto importante da Retrieval-Augmented Generation é o uso que ela faz de incorporações (embeddings): representações numéricas de informações que permitem que modelos de linguagem encontrem objetos semelhantes. Por exemplo, um modelo que utiliza embeddings é capaz de encontrar uma foto ou documento similar, com base em significados semânticos. Embeddings são armazenados em bancos de dados vetoriais que podem ser pesquisados e compreendidos, de forma eficiente e rápida, por modelos de inteligência artificial. Para garantir que as informações acessadas estejam sempre atualizadas, é importante que se atualize regularmente os documentos, e que se ajuste as representações vetoriais quando necessário.

Consultar informações relevantes (retrieve)

Quando uma solicitação de usuário é feita, ela é inicialmente convertida em representação vetorial e comparada com os bancos de dados vetoriais disponíveis. O banco de dados vetorial busca os vetores que são mais semelhantes à solicitação.

Expandir o prompt (augment)

Informações recuperadas são inseridas no contexto da solicitação original, por meio de técnicas de engenharia de prompt. Um prompt expandido é gerado, que inclui tanto a pergunta original quanto os dados relevantes. O processo permite que o LLM gere uma resposta mais precisa e informativa.

Técnicas de engenharia de prompt são métodos e estratégias para a criação e a otimização de prompts para modelos de linguagem de grande escala. Essas técnicas envolvem a formulação e a estruturação cuidadosa de prompts, para a obtenção das respostas e reações desejadas.

Gerar resposta (generate)

Após a Retrieval-Augmented Generation encontrar as informações relevantes, ela seguirá para a geração da resposta. A tecnologia utiliza as informações encontradas para gerar uma resposta em linguagem natural, empregando técnicas de processamento de linguagem natural, como o GPT-3, e traduzindo os dados para a nossa linguagem.

GPTs (Generative Pre-trained Transformers) são baseados na arquitetura de transformação, sendo treinados para entenderem e gerarem respostas na linguagem humana. Primeiramente, o modelo é treinado com grandes quantidades de dados de texto (pre-training) e posteriormente ajustado para executar tarefas específicas (fine-tuning).

Vantagens da Retrieval-Augmented Generation

Implementar a Retrieval-Augmented Generation em empresas oferece diferentes benefícios, entre eles:

Aumento da eficiência

Tempo é dinheiro, especialmente para empresas com recursos limitados. Já que a RAG é mais eficiente que grandes modelos generativos, ela reduz a quantidade de informações a serem processadas na fase de geração. Isso ocorre porque, na primeira fase, ela seleciona apenas os dados mais relevantes.

Redução dos custos

A implementação da Retrieval-Augmented Generation também pode levar a economias significativas. Ao automatizar tarefas rotineiras e reduzir a necessidade de pesquisas manuais, a tecnologia reduz custos com pessoal e ainda melhora a qualidade dos resultados obtidos. O custo de implementação da RAG também é menor do que o custo dos treinamentos de atualização de modelos de linguagem de grande escala.

Fornecimento de informações atualizadas

A Retrieval-Augmented Generation é capaz de fornecer informações sempre atualizadas, uma vez que ela conecta o LLM utilizado a feeds em tempo real de mídias sociais, a sites de notícias e a outras fontes constantemente atualizadas. Isso vai garantir que você receba sempre as informações mais atualizadas e relevantes.

Respostas rápidas a adaptadas ao mercado

Empresas que respondem mais precisa e rapidamente a mudanças de mercado e a necessidades de clientes têm maiores chances de se destacarem da concorrência. Ao conseguirem acessar informações relevantes com rapidez, além de atenderem clientes proativamente, empresas acabam se destacando das demais.

Oportunidades de desenvolvimento e teste

Ao controlar e ajustar as fontes de informação do LLM adotado, você poderá adaptar o seu sistema de forma flexível, às demandas em constante mudança e a uma utilização mais interfuncional. Além disso, será possível que você restrinja acessos a informações confidenciais configurando diferentes níveis de autorização. Isso garantirá que o modelo de linguagem de grande escala gere somente respostas apropriadas. Em casos de respostas incorretas, a RAG atua na correção de erros, especificamente quando o LLM baseia seus resultados em fontes de informação imprecisas.

- Uma plataforma para os modelos de IA mais avançados

- Preços justos e transparentes baseados em tokens

- Sem dependência de fornecedor com código aberto

Áreas de aplicação da Retrieval-Augmented Generation

A RAG pode ser utilizada para otimizar processos em diversas áreas dos negócios:

-

Para melhorar o atendimento ao cliente: Em se tratando de atendimento ao cliente, a emissão de respostas rápidas e precisas é fundamental. A RAG pode ajudar no aprimoramento do atendimento ao cliente ao recuperar informações relevantes de uma vasta base de conhecimento e fornecer respostas imediatas, por meio de live chats, sem que o cliente tenha de esperar. Isso não só alivia a equipe de suporte como aumenta a satisfação do cliente.

-

Na gestão do conhecimento: A RAG oferece apoio à gestão do conhecimento, por permitir que funcionários acessem informações relevantes com rapidez, sem que precisem realizar buscas em inúmeros arquivos.

-

Na integração de novos funcionários: Novos funcionários conseguirão se integrar mais rapidamente ao obterem acesso facilitado a todas as informações relevantes sobre a empresa. Seja manuais técnicos, de treinamento ou diretrizes internas, a RAG facilita a busca, o encontro e o uso de informações relevantes.

-

Na criação de conteúdo: A Retrieval-Augmented Generation pode auxiliar processos de criação de posts, artigos de blogs, descrições de produtos e outros conteúdos, combinando sua capacidade de geração de texto com a recuperação de informações de fontes confiáveis, tanto internas quanto externas.

-

Em pesquisas de mercado: A RAG pode ser utilizada para a realização de pesquisas de mercado, ao recuperar dados e tendências relevantes. As informações por ela coletadas podem facilitar a análise e a compreensão dos movimentos do mercado, assim como do comportamento dos clientes.

-

Na produção: Na produção, a Retrieval-Augmented Generation pode ser usada na previsão do consumo e no planejamento automatizado de pessoal, ambos baseados em estatísticas passadas. Nesse sentido, ela ajuda a utilizar recursos de forma mais eficiente e a otimizar a organização da produção.

-

Na venda de produtos: A RAG pode aumentar o índice de vendas ao ajudar vendedores a acessar informações relevantes sobre produtos com rapidez.